Уряд Австралії оголосив про раптові восьмитижневі консультації, які намагатимуться зрозуміти, чи слід заборонити будь-які «високоризикові» інструменти штучного інтелекту.

Інші регіони, включаючи Сполучені Штати, Європейський Союз і Китай, також запустили заходи для розуміння та потенційного пом’якшення ризиків, пов’язаних зі швидким розвитком штучного інтелекту в останні місяці.

1 червня міністр промисловості та науки Ед Хусік оголосив про випуск двох документів — дискусійного документа на тему «Безпечний і відповідальний штучний інтелект в Австралії» та звіту про генеративний штучний інтелект від Національної ради з науки і технологій.

Документи надійшли разом із консультаціями, які триватимуть до 26 липня.

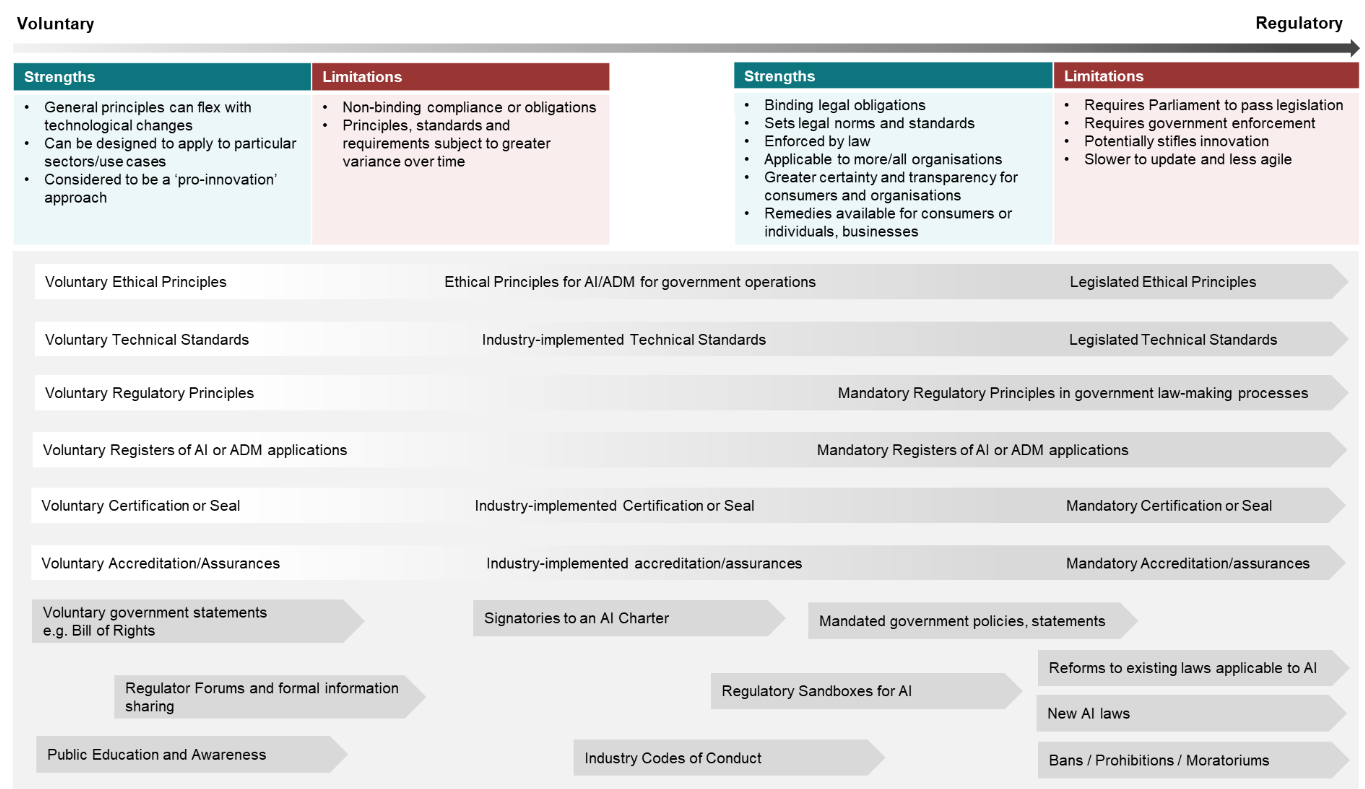

Уряд хоче отримати відгук про те, як підтримувати «безпечне та відповідальне використання штучного інтелекту», і обговорює, чи слід застосувати добровільні підходи, такі як етичні рамки, чи потрібне спеціальне регулювання, чи поєднати обидва підходи.

Запитання в консультації прямо запитує: «Чи слід повністю заборонити будь-які додатки чи технології штучного інтелекту з високим ризиком?»і які критерії слід використовувати для визначення таких інструментів ШІ, які слід заборонити.

Проект матриці ризиків для моделей штучного інтелекту було включено для відгуків у всебічний документ для обговорення. Хоча лише для того, щоб навести приклади, він класифікував ШІ в безпілотних автомобілях як «високий ризик», тоді як генеративний інструмент ШІ, який використовується для таких цілей, як створення медичних записів пацієнтів, вважався «середнім ризиком».

#AI is already part of our lives. As the technology develops, we need to ensure it meets Australians’ expectations of responsible use. Be part of the @IndustryGovAu discussion, below. https://t.co/Gz11JCXlsG

— Australia’s Chief Scientist (@ScienceChiefAu) June 1, 2023

У документі було підкреслено «позитивне» використання штучного інтелекту в медичній, інженерній та юридичній галузях, а також його «шкідливе» застосування, таке як інструменти deepfake, використання для створення фейкових новин і випадки, коли боти штучного інтелекту заохочували до самоушкодження.

Упередженість моделей штучного інтелекту та «галюцинації» — безглузда або неправдива інформація, створена штучним інтелектом — також були підняті як проблеми.

За темою: CSO Microsoft каже, що штучний інтелект допоможе людям процвітати, і все одно підписує лист про судний день

У документі для обговорення стверджується, що впровадження штучного інтелекту є «відносно низьким» у країні, оскільки вона має «низький рівень суспільної довіри». Він також вказав на регулювання ШІ в інших юрисдикціях і тимчасову заборону Італії на ChatGPT.

Водночас у звіті Національної науково-технічної ради говориться, що Австралія має деякі переваги у сфері штучного інтелекту в робототехніці та комп’ютерному зорі, але її «основний фундаментальний потенціал у [великих мовних моделях] і пов’язаних областях є відносно слабким», і додається:

«Концентрація генеративних ресурсів штучного інтелекту в невеликій кількості великих транснаціональних і переважно американських технологічних компаній створює потенційні [sic] ризики для Австралії».

У звіті далі обговорювалося глобальне регулювання штучного інтелекту, наводилися приклади генеративних моделей штучного інтелекту та висловлювалося, що вони «ймовірно вплинуть на все: від банківської справи та фінансів до державних послуг, освіти та креативних індустрій».

AI Eye: 25 тис. трейдерів роблять ставки на вибір акцій ChatGPT, штучний інтелект не вміє кидати кубики тощо