Согласно новому исследованию, ChatGPT, крупному чат-боту на основе модели большого языка (LLM), якобы не хватает объективности, когда речь идет о политических вопросах.

Исследователи компьютерных и информационных наук из Соединенного Королевства и Бразилии утверждают, что нашли «убедительные доказательства» того, что ChatGPT представляет значительный политический уклон в сторону левой части политического спектра. Аналитики — Фабио Мотоки, Вальдемар Пиньо и Виктор Родригес — поделились своим мнением в исследовании, опубликованном журналом Public Choice 17 августа.

Исследователи утверждали, что тексты, созданные LLM, такими как ChatGPT, могут содержать фактические ошибки и предубеждения, которые вводят читателей в заблуждение, и могут расширять существующие проблемы политической предвзятости, возникающие в традиционных СМИ. Таким образом, результаты имеют важные последствия для политиков и заинтересованных сторон в СМИ, политике и научных кругах, отмечают авторы исследования, добавляя:

«Присутствие политической предвзятости в его ответах может иметь те же негативные политические и электоральные последствия, что и предвзятость в традиционных СМИ и социальных сетях».

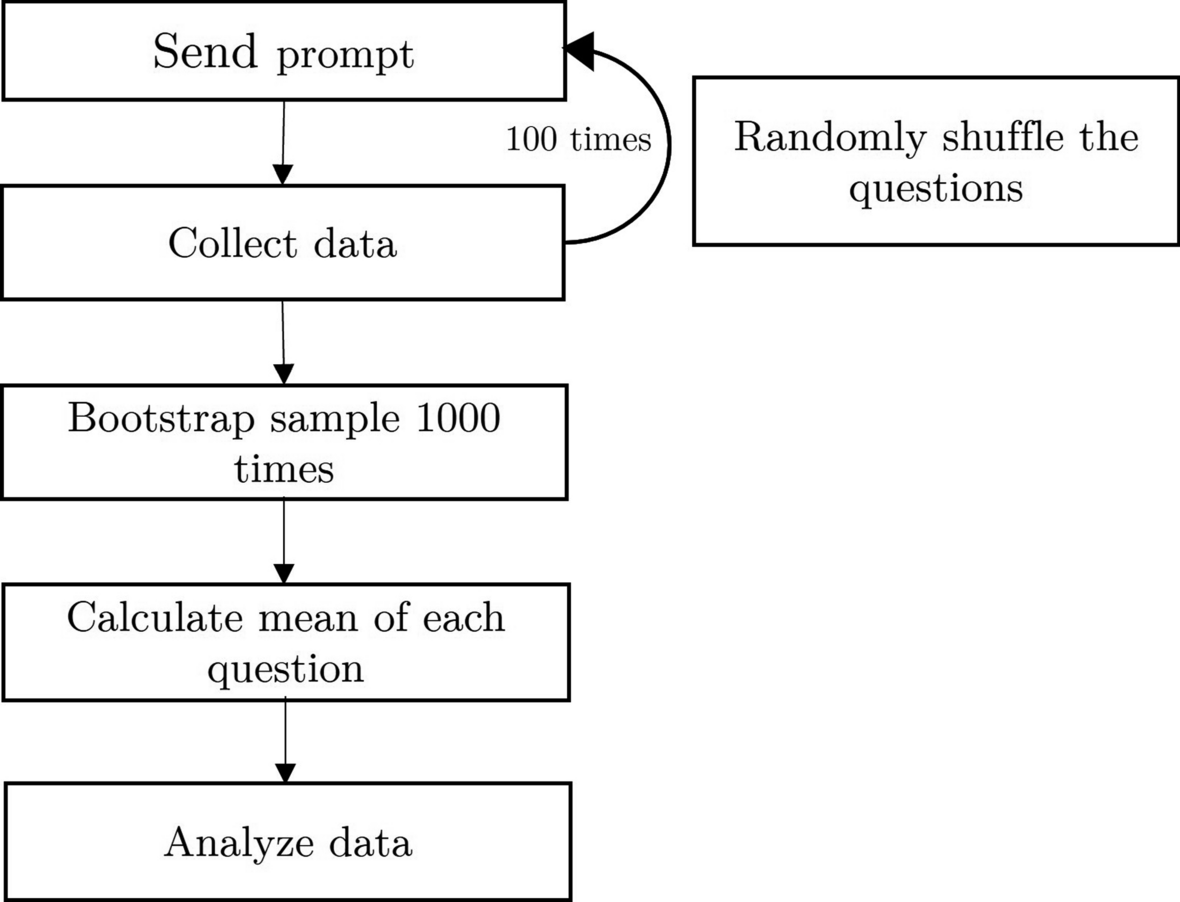

Исследование основано на эмпирическом подходе и изучении серии анкет, предоставленных ChatGPT. Эмпирическая стратегия начинается с просьбы ChatGPT ответить на вопросы политического компаса, которые отражают политическую ориентацию респондента. Подход также основан на тестах, в которых ChatGPT выдает себя за среднего демократа или республиканца.

Результаты тестов показывают, что алгоритм ChatGPT по умолчанию смещен в сторону ответов представителей демократического спектра в США. Исследователи также утверждали, что политическая предвзятость ChatGPT не ограничивается контекстом США. Они написали:

«Алгоритм смещен в сторону демократов в США, Лулы в Бразилии и Лейбористской партии в Великобритании. В сочетании наши основные тесты и тесты на надежность убедительно показывают, что это явление действительно является своего рода предвзятостью, а не механическим результатом».

Аналитики подчеркнули, что точный источник политической предвзятости ChatGPT определить сложно. Исследователи даже пытались принудительно перевести ChatGPT в своего рода режим разработчика, чтобы попытаться получить доступ к любым знаниям о предвзятых данных, но LLM «категорически подтвердил», что ChatGPT и OpenAI беспристрастны.

OpenAI не сразу ответил на запрос Cointelegraph о комментариях.

Связанный: OpenAI говорит, что ChatGPT-4 сокращает время модерации контента с месяцев до часов

Авторы исследования предположили, что может быть как минимум два потенциальных источника смещения, включая данные обучения, а также сам алгоритм.

«Наиболее вероятным сценарием является то, что оба источника предвзятости в некоторой степени влияют на результаты ChatGPT, и разделение этих двух компонентов (обучающие данные и алгоритм), хотя и нетривиальное, безусловно, является актуальной темой для будущих исследований», — заключили исследователи.

Политические предубеждения — не единственная проблема, связанная с инструментами искусственного интеллекта, такими как ChatGPT или другими. На фоне продолжающегося массового внедрения ChatGPT люди во всем мире отмечают множество связанных с ним рисков, включая проблемы с конфиденциальностью и сложное образование. Некоторые инструменты ИИ, такие как генераторы контента ИИ, даже вызывают опасения по поводу процесса проверки личности на биржах криптовалют.

AI Eye: Apple разрабатывает карманный ИИ, фальшивую музыкальную сделку, гипнотизирует GPT-4