Повідомляється, що американські військові використовували Anthropic під час великого авіаудару по Ірану лише через кілька годин після того, як президент Дональд Трамп наказав федеральним агентствам припинити використання систем компанії.

Військові команди, включаючи Центральне командування США (CENTCOM) на Близькому Сході, використовували модель Claude AI від Anthropic для оперативної підтримки, за словами людей, знайомих з питанням, цитованих The Wall Street Journal. Повідомляється, що інструмент допоміг з аналізом розвідувальних даних, виявленням потенційних цілей і моделюванням поля бою.

Цей інцидент показує, наскільки розвинені системи ШІ стали вбудованими в оборонні операції. Навіть коли адміністрація розірвала зв’язки з компанією, Клод залишався інтегрованим у військові робочі процеси.

У п’ятницю адміністрація Трампа наказала агентствам припинити співпрацю з компанією та наказала Міністерству оборони розглядати її як потенційну загрозу безпеці. Цей наказ надійшов після зриву переговорів щодо контракту, коли Anthropic відмовився надати необмежене військове використання свого штучного інтелекту для будь-яких законних сценаріїв, про які запитували чиновники оборони.

Claude AI з Anthropic використовується для секретних операцій

Раніше Anthropic уклала багаторічний контракт Пентагону на суму до 200 мільйонів доларів разом із кількома великими лабораторіями ШІ. Завдяки партнерству між Palantir і Amazon Web Services, Клод отримав дозвіл на секретну розвідку та оперативні робочі процеси. Повідомляється, що система також брала участь у попередніх операціях, включаючи січневу місію у Венесуелі, яка призвела до захоплення президента Ніколаса Мадуро.

Напруженість посилилася після того, як міністр оборони Піт Хегсет вимагав від компанії дозволу на необмежене військове використання своїх моделей. Генеральний директор Anthropic Даріо Амодей відхилив прохання, описавши певні додатки як етичні межі, які компанія не перетинатиме, навіть якщо це означатиме втрату державного бізнесу.

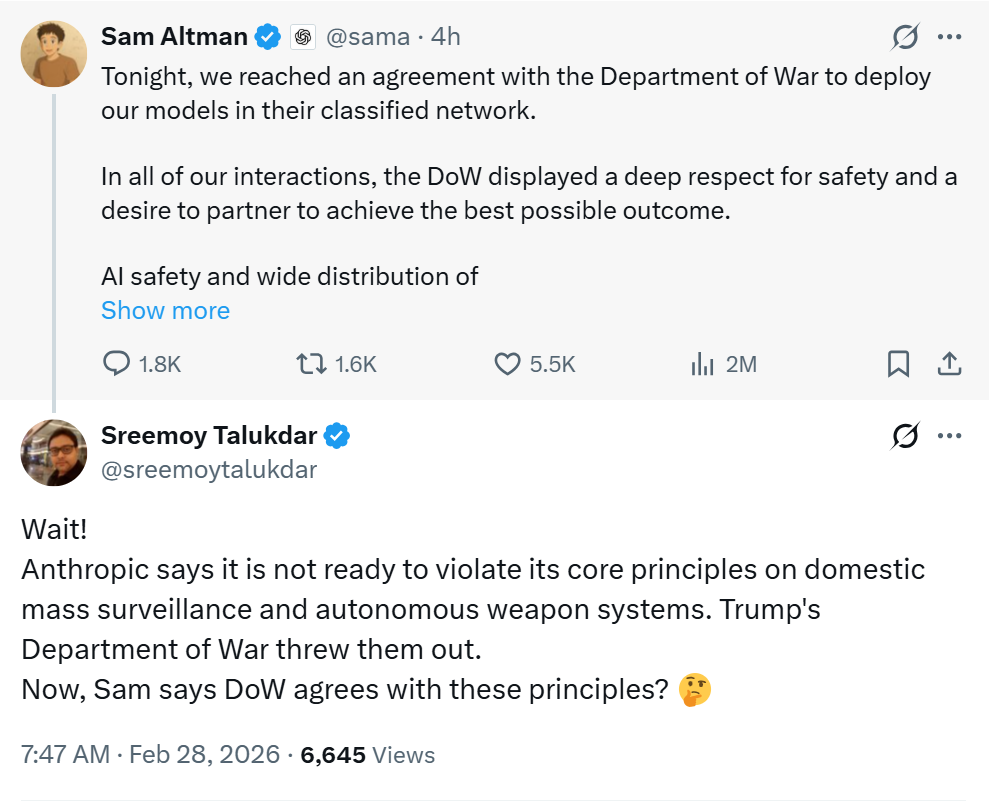

У відповідь Пентагон почав підбирати постачальників на заміну, досягнувши угоди з OpenAI про розгортання своїх моделей ШІ в секретних військових мережах.

Генеральний директор Anthropic відкидає заборону Пентагону

Під час суботнього інтерв’ю генеральний директор Anthropic Даріо Амодей сказав, що компанія виступає проти використання своїх моделей штучного інтелекту для масового домашнього спостереження та повністю автономної зброї, відповідаючи на директиву уряду США, яка назвала фірму «ризиком для ланцюга поставок» і заборонила підрядникам використовувати її продукцію.

Він стверджував, що деякі програми перетинають фундаментальні межі, наголошуючи, що військові рішення повинні залишатися під контролем людини, а не повністю делегуватися машинам.