Демократи в Сенаті та один незалежний законодавець надіслали листа генеральному директору OpenAI Сему Альтману щодо стандартів безпеки компанії та практики працевлаштування інформаторів.

Мабуть, найважливішою частиною листа, який вперше отримав The Washington Post, був пункт 9, у якому говорилося: «Чи візьме OpenAI зобов’язання надати свою наступну базову модель урядовим установам США для тестування, перегляду, аналізу та оцінки перед розгортанням?»

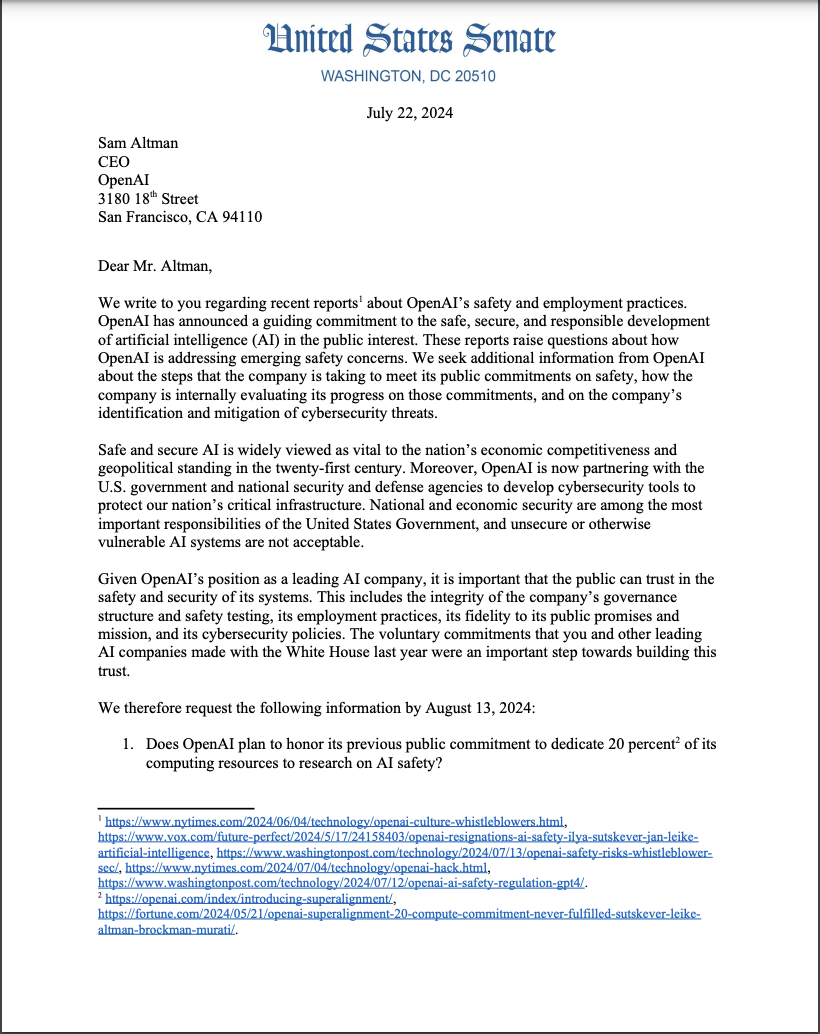

У листі було зазначено 11 додаткових пунктів, які необхідно розглянути, включаючи забезпечення зобов’язань OpenAI виділити 20% своєї обчислювальної потужності на дослідження безпеки палива та протоколи, щоб запобігти крадіжці зловмисником або іноземним противником продуктів ШІ з OpenAI.

Регуляторний контроль

Хоча регуляторний контроль не є чимось новим для OpenAI та сектору штучного інтелекту, що охоплює його, лист від законодавців-демократів був викликаний повідомленнями інформаторів про слабкі стандарти безпеки для GPT-4 Omni, щоб гарантувати, що випуск продукту на ринок не відкладено.

Пов’язане: Синхронізація, ChatGPT, щоб допомогти паралізованим пацієнтам знову спілкуватися в чаті та надсилати текстові повідомлення

Викривачі OpenAI також стверджували, що спроби винести занепокоєння щодо безпеки до керівництва зустрілися помстою та нібито незаконними угодами про нерозголошення, що змусило інформаторів подати скаргу до Комісії з цінних паперів і бірж у червні 2024 року.

Невдовзі після того, як у липні технічні гіганти Microsoft і Apple відмовилися від членства в раді директорів OpenAI через посилений регулятивний контроль, рішення не займати місце в раді було прийнято, незважаючи на інвестиції Microsoft у OpenAI у розмірі 13 мільярдів доларів у 2023 році.

Екзистенціальні страхи зберігаються

Колишній співробітник OpenAI Вільям Сондерс нещодавно розповів, що він залишив компанію, оскільки відчував, що поточні дослідження OpenAI можуть становити загрозу для існування людства, порівнюючи потенційну траєкторію OpenAI із сумнозвісною катастрофою RMS Titanic у 1912 році.

Сондерс уточнив, що його не хвилює поточна ітерація великої мовної моделі ChatGPT від OpenAI, а більше хвилює майбутні версії ChatGPT і потенційний розвиток передового надлюдського інтелекту.

Викривач стверджував, що співробітники, які працюють у секторі штучного інтелекту, мають право попереджати громадськість про потенційно небезпечні можливості, які демонструє швидкий розвиток синтетичного інтелекту.