Леопольд Ашенбреннер, бывший исследователь безопасности из компании OpenAI, создателя ChatGPT, уделил особое внимание общему искусственному интеллекту (AGI) в своей новой серии эссе об искусственном интеллекте (ИИ).

Серия, получившая название «Ситуационная осведомленность», предлагает взглянуть на состояние систем искусственного интеллекта и их многообещающий потенциал в следующем десятилетии. Полная серия эссе собрана в 165-страничный PDF-файл, обновленный 4 июня.

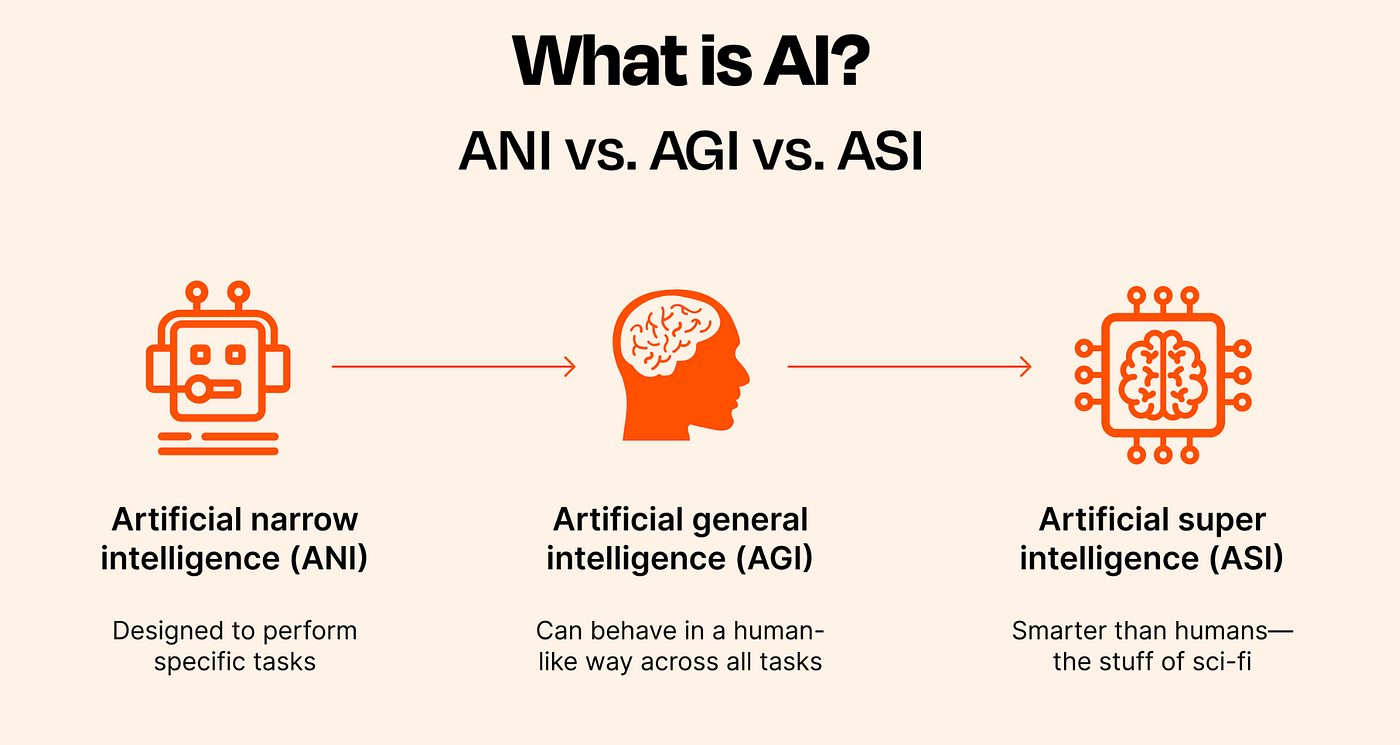

В своих эссе исследователь уделил особое внимание AGI — типу искусственного интеллекта, который соответствует человеческим возможностям или превосходит их в широком спектре когнитивных задач. AGI — это один из многих различных типов искусственного интеллекта, включая искусственный узкий интеллект, или ANI, и искусственный сверхинтеллект, или ASI.

«Создание искусственного интеллекта к 2027 году поразительно правдоподобно», — заявил Ашенбреннер, предсказав, что машины с искусственным интеллектом обгонят выпускников колледжей к 2025 или 2026 году. Он написал:

«К концу десятилетия они [машины AGI] будут умнее вас или меня;у нас будет сверхинтеллект в истинном смысле этого слова. Попутно будут задействованы силы национальной безопасности, которых не было уже полвека […]»

По мнению Ашенбреннера, системы искусственного интеллекта потенциально могут обладать интеллектуальными способностями, сравнимыми с интеллектуальными способностями профессионального ученого-компьютерщика. Он также сделал еще одно смелое предсказание о том, что лаборатории искусственного интеллекта смогут обучать языковые модели общего назначения за считанные минуты, заявив:

«Для сравнения, предположим, что обучение GPT-4 заняло 3 месяца. В 2027 году ведущая лаборатория искусственного интеллекта сможет обучить модель уровня GPT-4 за минуту».

Предсказывая успех AGI, Ашенбреннер призвал сообщество признать реальность AGI. По словам исследователя, «самые умные люди» в индустрии искусственного интеллекта сошлись на точке зрения, которую он называет «реализмом AGI», которая основана на трех основополагающих принципах, связанных с национальной безопасностью и развитием искусственного интеллекта в Соединенных Штатах.

Связанный: Бывшие сотрудники OpenAI и Anthropic призывают к «праву предупреждать» о рисках ИИ

Серия AGI Ашенбреннера выходит спустя некоторое время после того, как он, как сообщается, был уволен за предполагаемую «утечку» информации из OpenAI. Сообщается, что Ашенбреннер также был союзником главного ученого OpenAI Ильи Суцкевера, который, как сообщается, участвовал в неудавшейся попытке свергнуть генерального директора OpenAI Сэма Альтмана в 2023 году. Последняя серия Ашенбреннера также посвящена Суцкеверу.

Ашенбреннер также недавно основал инвестиционную фирму, специализирующуюся на AGI, с ключевыми инвестициями таких фигур, как генеральный директор Stripe Патрик Коллисон, говорится в его блоге.