Фирма искусственного интеллекта Anpropic выпустила последние поколения своих чат -ботов на фоне критики поведения в области тестирования, которое может сообщить некоторым пользователям властям.

22 мая Anpropic обнародовал Claude Opus 4 и Claude Sonnet 4, утверждая, что Claude Opus 4 – его самая мощная модель, «и лучшая модель кодирования в мире», в то время как Claude Sonnet 4 является значительным обновлением от своего предшественника, «обеспечивая превосходное кодирование и рассуждение».

Фирма добавила, что оба обновления являются гибридными моделями, предлагающими два режима-«почти мгновенные ответы и расширенное мышление для более глубоких рассуждений».

Обе модели ИИ также могут чередовать рассуждения, исследования и использование инструментов, такие как веб -поиск, для улучшения ответов.

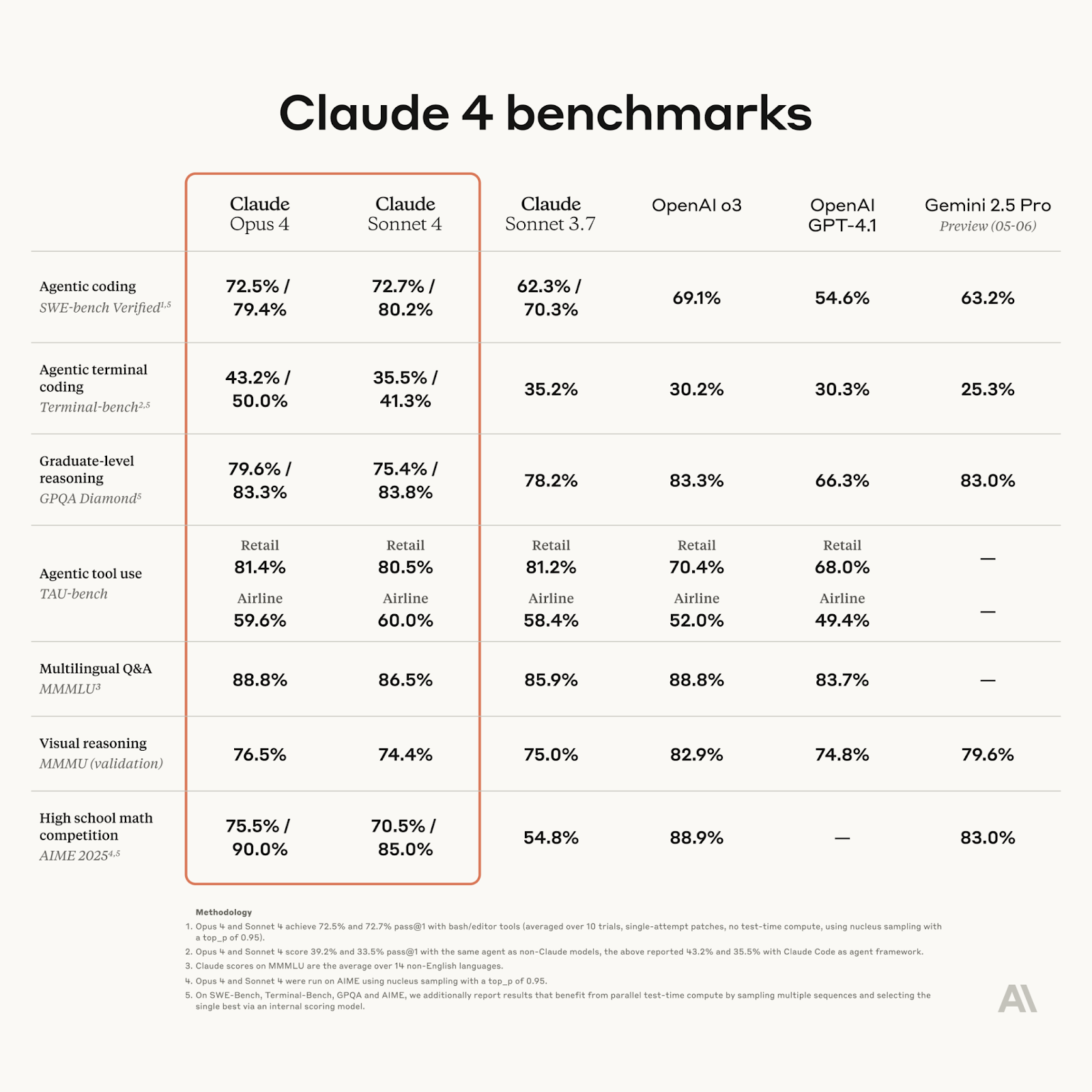

Anpropic добавил, что Claude Opus 4 превосходит конкурентов в контрольных показателях агента. Он также способен работать непрерывно в течение нескольких часов над сложными, давними задачами, «значительно расширяя то, что могут делать агенты искусственного интеллекта».

Антрические утверждения, что чат-бот достиг 72,5% баллов по строгому эталону разработки программного обеспечения, опередив GPT-4.1 Openai, который набрал 54,6% после его апрельского запуска.

Связанный: Openai игнорировал экспертов, когда он выпустил чрезмерно приятный Chatgpt

Основные игроки индустрии искусственного интеллекта в 2025 году повернулись к «моделям рассуждений», которые будут методично решать проблемы перед реагированием.

OpenAI инициировал сдвиг в декабре с его серией «O», за которым последовал Google Gemini 2.5 Pro с экспериментальной способностью «глубоко мышления».

Крысы Клауда при неправильном использовании в тестировании

Первая конференция разработчиков Антрика 22 мая была омрачена противоречиями и негативной реакцией по поводу особенности Claude 4 Opus.

Разработчики и пользователи решительно отреагировали на откровения, что модель может автономно сообщать пользователей властям, если она обнаружит «вопиюще аморальное» поведение, согласно VentureBeat.

В отчете приведен исследователь по выравниванию AI AI Сэм Боуман, который написал на X, что чат-бот будет «использовать инструменты командной строки для контакта с прессой, контактных регуляторов, попытаться заблокировать вас из соответствующих систем или все вышеперечисленное».

Тем не менее, Боуман позже заявил, что «удалил более ранний твит на разоблачение, так как его вытащили из контекста».

Он пояснил, что эта функция произошла только в «средах тестирования, где мы даем ей необычайно свободный доступ к инструментам и очень необычным инструкциям».

Генеральный директор AI Stability AI, Эмад Мостак, сказал антропной команде: «Это совершенно неправильное поведение, и вам нужно отключить это – это огромное предательство доверия и скользкий склон».