По словам исследователей Apple, в рамках развития искусственного общего интеллекта (AGI) все еще есть долгий путь для работы, которые обнаружили, что у ведущих моделей искусственного интеллекта по -прежнему возникают проблемы с рассуждением.

Недавние обновления ведущих моделей AI на больших языках (LLMS), таких как CHATGPT Openai и Claude’s, включали в себя большие модели рассуждений (LRM), но их фундаментальные возможности, масштабирование свойств и ограничения «остаются недостаточно понятными», – сказали исследователи Apple в июньском документе, называемом «иллюзией мышления».

Они отметили, что текущие оценки в первую очередь фокусируются на установленных математических и кодирующих критериях, «подчеркивая точность окончательного ответа».

Тем не менее, эта оценка не дает представления о возможностях рассуждений моделей ИИ, сказали они.

Исследование контрастирует с ожиданием, что искусственный общий интеллект находится всего через несколько лет.

Исследователи Apple тестируют «мышление» модели ИИ

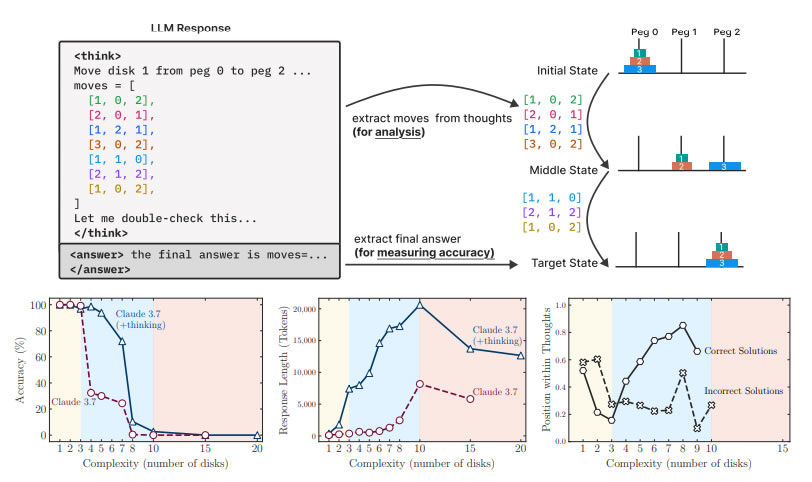

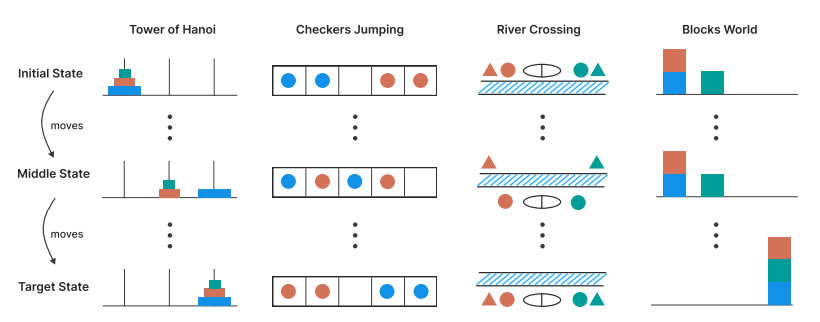

Исследователи разработали различные игры головоломки, чтобы проверить «мышление» и «не мышление» вариантов Claude Sonnet, O3-Mini и O1, а также чат-ботов Deepseek-R1 и V3 за пределами стандартных математических тестов.

Они обнаружили, что «Frontier LRM сталкиваются с полным крахом точности за пределами определенных сложностей», не эффективно не обобщают рассуждения, и их преимущество исчезает с растущей сложностью, вопреки ожиданиям в отношении возможностей AGI.

«Мы обнаружили, что LRM имеют ограничения в точных вычислениях: они не могут использовать явные алгоритмы и бессмысленно разум между головоломками».

Ай чат -боты, скажем, исследователи

Они обнаружили непоследовательные и мелкие рассуждения с моделями, а также наблюдали за переобожением, при этом рано генерируют правильные ответы, а затем бродили на неправильные рассуждения.

Связанный: Утверждающая роль ИИ в Web3, бросая вызов Defi и Gaming: Dappradar

Исследователи пришли к выводу, что LRMs имитируют модели рассуждений, не усвоив и не обобщая их, что не соответствует аргументированию.

«Эти идеи оспаривают преобладающие предположения о возможностях LRM и предполагают, что текущие подходы могут столкнуться с фундаментальными барьерами для обобщаемых рассуждений».

Гонка по развитию Agi

Аги – это святой Грааль развития ИИ, состояние, где машина может думать и разумно, как человек, и находится на одном уровне с человеческим интеллектом.

В январе генеральный директор Openai Сэм Альтман сказал, что фирма была ближе к строительству AGI, чем когда -либо прежде. «Теперь мы уверены, что знаем, как построить AGI, как мы традиционно поняли это», – сказал он в то время.

В ноябре генеральный директор Anpropic Дарио Амодеэй сказал, что AGI превзойдет возможности человека в течение следующего года или двух. «Если вы просто смотрите на то, что эти возможности увеличиваются, это заставляет вас думать, что мы доберемся до 2026 или 2027 года», – сказал он.