Компания OpenAI, занимающаяся искусственным интеллектом, сообщила, что выявила и сорвала несколько онлайн-кампаний, в которых ее технология использовалась для манипулирования общественным мнением по всему миру.

30 мая Сэм Альтман, основатель ИИ-компании OpenAI, заявил, что она «закрыла учетные записи, связанные с тайными операциями влияния».

«За последние три месяца мы сорвали пять тайных IO [операций влияния], которые пытались использовать наши модели для поддержки мошеннической деятельности в Интернете».

Злоумышленники использовали ИИ для создания комментариев к статьям, создания имен и биографий для учетных записей в социальных сетях, а также для перевода и корректуры текстов.

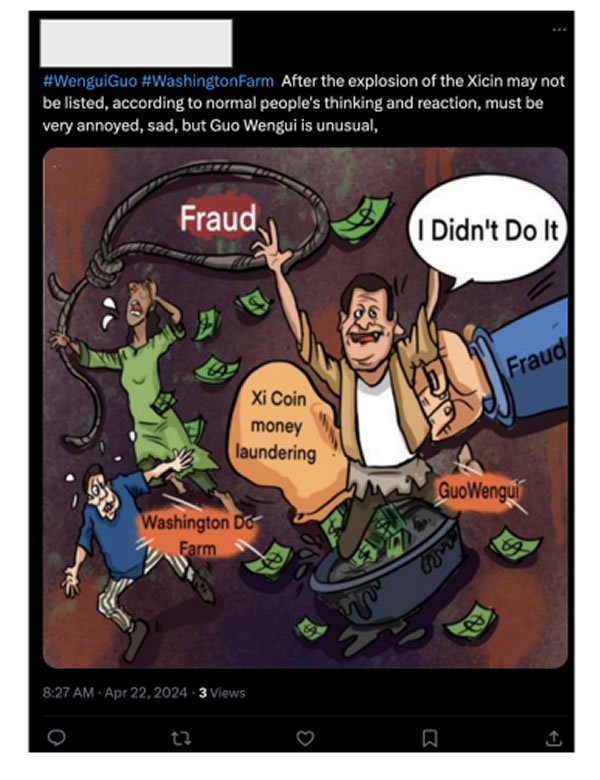

Фирма, стоящая за ChatGPT, заявила, что операция под названием «Spamouflage» использовала OpenAI для исследования социальных сетей и создания многоязычного контента на таких платформах, как X, Medium и Blogspot, в попытке «манипулировать общественным мнением или влиять на политические результаты».

Он также использовал искусственный интеллект для отладки кода и управления базами данных и веб-сайтами.

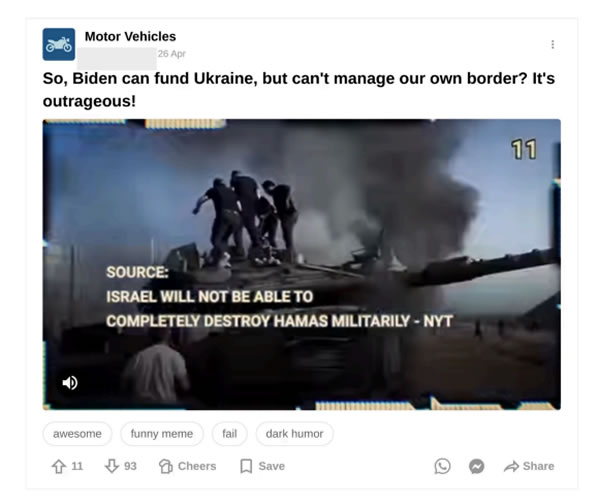

Кроме того, операция под названием «Плохая грамматика» была нацелена на Украину, Молдову, страны Балтии и США, используя модели OpenAI для запуска ботов Telegram и генерации политических комментариев.

Другая группа под названием Doppelganger использовала модели искусственного интеллекта для создания комментариев на английском, французском, немецком, итальянском и польском языках, которые были опубликованы на X и 9GAG и которые также предназначены для манипулирования общественным мнением, добавили они.

OpenAI также упомянула группу под названием «Международный союз виртуальных медиа», которая использовала эту технологию для создания длинных статей, заголовков и контента веб-сайтов, опубликованных на их связанном веб-сайте.

OpenAI заявила, что также разрушила коммерческую компанию STOIC, которая использовала ИИ для создания статей и комментариев в социальных сетях, таких как Instagram, Facebook, X и на веб-сайтах, связанных с этой операцией.

OpenAI объяснила, что контент, публикуемый этими различными операциями, посвящен широкому кругу вопросов:

«Включая вторжение России в Украину, конфликт в Газе, выборы в Индии, политику в Европе и США, а также критику китайского правительства со стороны китайских диссидентов и иностранных правительств».

Связанный: OpenAI Сэма Альтмана, как сообщается, ведет переговоры о партнерстве с другой его фирмой, Worldcoin

«Наши тематические исследования содержат примеры некоторых из наиболее широко освещаемых и самых продолжительных кампаний влияния, которые активны в настоящее время», — сказал The New York Times Бен Ниммо, главный исследователь OpenAI, написавший отчет.

Издание также сообщило, что впервые крупная компания, занимающаяся искусственным интеллектом, раскрыла, как ее конкретные инструменты использовались для онлайн-обмана.

«Пока что эти операции, похоже, не получили существенного увеличения вовлеченности или охвата аудитории в результате наших услуг», — заключил OpenAI.