Леопольд Ашенбреннер, колишній дослідник безпеки в компанії OpenAI, яка створила ChatGPT, подвоїв увагу до загального штучного інтелекту (AGI) у своїй новій серії есе про штучний інтелект (ШІ).

Серія під назвою «Ситуаційна обізнаність» пропонує погляд на стан систем штучного інтелекту та їхній багатообіцяючий потенціал у наступному десятилітті. Повна серія есе зібрана у 165-сторінковому PDF-файлі, оновленому 4 червня.

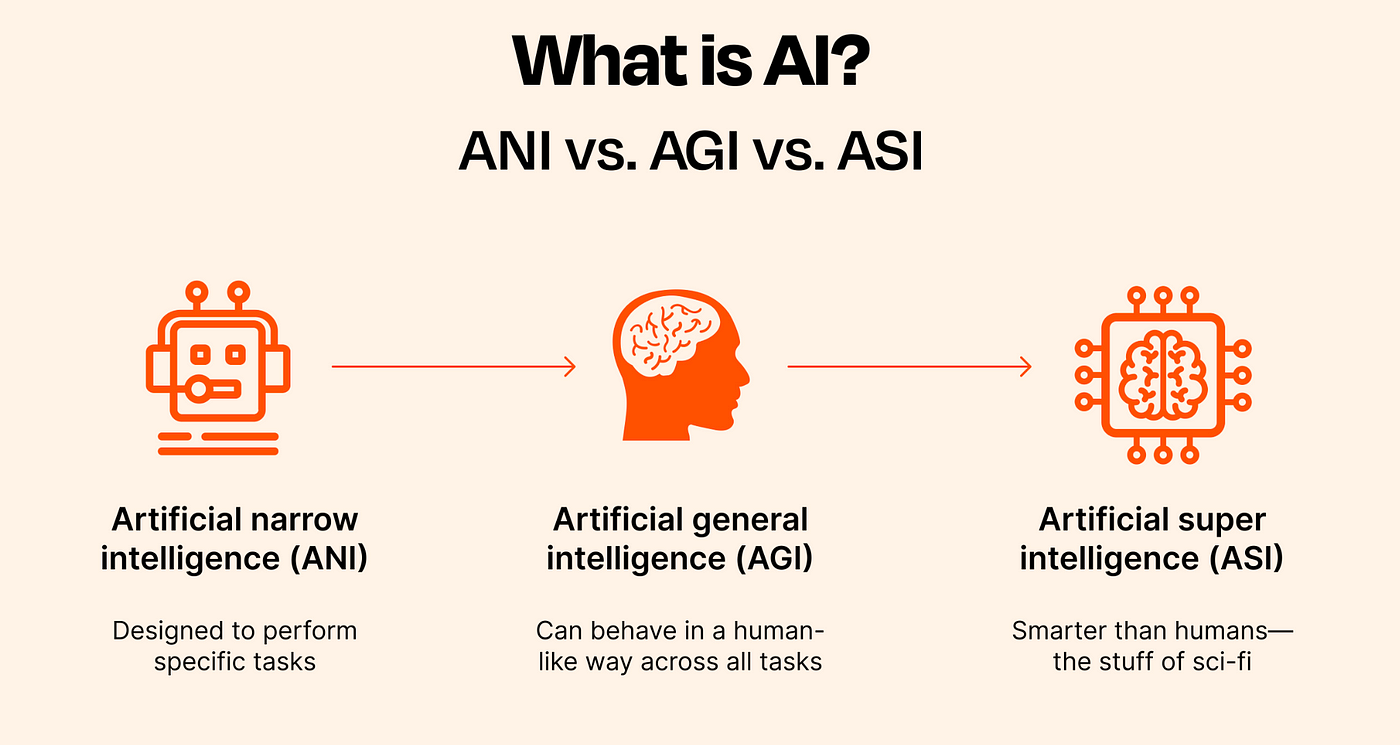

У своїх есе дослідник звернув особливу увагу на AGI, тип штучного інтелекту, який відповідає або перевершує людські можливості в широкому діапазоні когнітивних завдань. AGI — це один із багатьох різних типів штучного інтелекту, включаючи штучний вузький інтелект (ANI) і штучний суперінтелект (ASI).

«AGI до 2027 року є вражаюче правдоподібним», — заявив Ашенбреннер, передбачаючи, що машини AGI випереджатимуть випускників коледжів до 2025 або 2026 років. Він написав:

«До кінця десятиліття вони [машини AGI] будуть розумнішими за вас чи мене;ми матимемо суперінтелект, у прямому сенсі цього слова. По дорозі будуть розв’язані національні сили безпеки, яких не бачили півстоліття […]”

За словами Ашенбреннера, системи штучного інтелекту потенційно можуть володіти інтелектуальними можливостями, порівнянними з інтелектуальними можливостями професійного комп’ютерника. Він також зробив ще один сміливий прогноз про те, що лабораторії ШІ зможуть навчити мовні моделі загального призначення за лічені хвилини, заявивши:

«Щоб поглянути на це в перспективі, припустімо, що навчання GPT-4 тривало 3 місяці. У 2027 році провідна лабораторія ШІ зможе навчити модель рівня GPT-4 за хвилину».

Прогнозуючи успіх AGI, Ашенбреннер закликав спільноту зіткнутися з реальністю AGI. За словами дослідника, «найрозумніші люди» в індустрії штучного інтелекту зійшлися на перспективі, яку він називає «реалізмом AGI», яка базується на трьох основоположних принципах, пов’язаних з національною безпекою та розвитком штучного інтелекту в Сполучених Штатах.

За темою: колишні співробітники OpenAI, Anthropic закликають до «права попереджати» про ризики ШІ

Серія AGI Ашенбреннера з’явилася через деякий час після того, як його, як повідомляється, звільнили за нібито «витік» інформації з OpenAI. Повідомляється, що Ашенбреннер також був союзником головного наукового співробітника OpenAI Іллі Суцкевера, який, як повідомляється, брав участь у невдалій спробі усунути генерального директора OpenAI Сема Альтмана в 2023 році. Остання серія Ашенбреннера також присвячена Сацкеверу.

Ашенбреннер також нещодавно заснував інвестиційну компанію, зосереджену на AGI, з якорними інвестиціями таких фігур, як генеральний директор Stripe Патрік Коллісон, йдеться в його блозі.