За словами дослідників Apple, які виявили, що в провідних моделях AI все ще виникає тривалий шлях до розвитку штучного загального інтелекту (AGI), як і раніше, є проблеми з міркуваннями.

Останні оновлення провідних моделей великих мов (LLMS), таких як Chatgpt OpenAI та Claude Antropic, включали великі моделі міркувань (LRMS), але їх основні можливості, масштабування властивостей та обмеження “залишаються недостатньо зрозумілими”, – сказали дослідники Apple у червневому папері під назвою “Ілюзія мислення”.

Вони зазначили, що поточні оцінки в першу чергу зосереджуються на встановлених математичних та кодувальних орієнтирах, “підкреслюючи остаточну точність відповіді”.

Однак ця оцінка не дає розуміння можливостей міркувань моделей AI, сказали вони.

Дослідження контрастує з очікуванням, що штучний загальний інтелект знаходиться всього за кілька років.

Дослідники Apple тестують моделі “мислення”

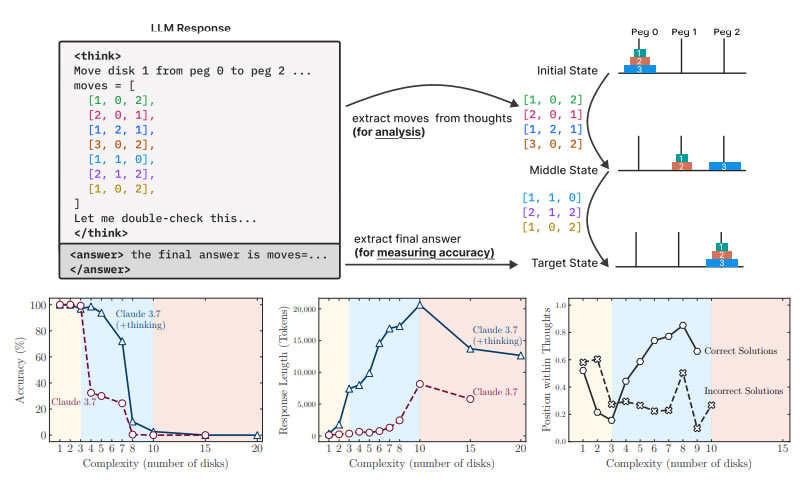

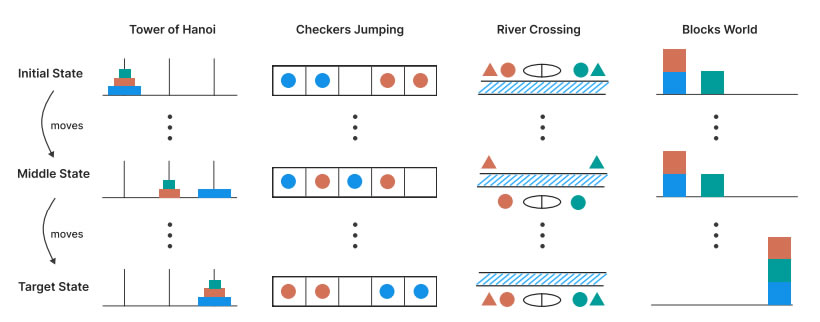

Дослідники розробили різні ігри-головоломки для перевірки “мислення” та “непохитних” варіантів Claude Sonnet, O3-Mini та O1, а також Chatbots OpenAI та Deepseek-R1 та V3 за межами стандартних математичних орієнтирів.

Вони виявили, що “прикордонні ЛРМ стикаються з повним крахом точності, що перевищує певні складності”, не узагальнюйте міркування ефективно, і їх перевага зникає зі зростанням складності, що суперечить очікуванням можливостей AGI.

“Ми виявили, що LRMS має обмеження в точному обчисленні: вони не вживають явних алгоритмів і розумно в умовах головоломок”.

AI Chatbots переосмислюють, кажуть дослідники

Вони знайшли непослідовні та неглибокі міркування з моделями, а також спостерігали за собою, а чат -боти AI генерували правильні відповіді рано, а потім блукали в неправильні міркування.

Пов’язано: AI затверджуюча роль у Web3, викликаючи Defi та Gaming: Dappadar

Дослідники дійшли висновку, що LRMS імітують моделі міркувань, не по-справжньому інтерналізуючи та узагальнюючи їх, що не відповідає міркуванню Agi-рівня.

“Ці розуміння оскаржують, що переважають припущення щодо можливостей LRM та припускають, що поточні підходи можуть стикатися з основними бар’єрами для узагальнених міркувань”.

Гонка на розвиток AGI

AGI – це святий Грааль розвитку AI, стан, де машина може думати і міркувати, як людина, і нарівні з людським інтелектом.

У січні генеральний директор OpenAI Сем Альтман заявив, що фірма ближче до будівництва AGI, ніж будь -коли раніше.”Зараз ми впевнені, що знаємо, як побудувати AGI, як ми традиційно зрозуміли це”, – сказав він у той час.

У листопаді генеральний директор антропії Даріо Амодеей заявив, що AGI перевищить людські можливості в наступному році -два.”Якщо ви просто очне яблука, швидкість, з якою ці можливості збільшуються, це змушує вас думати, що ми потрапимо туди до 2026 або 2027 років”, – сказав він.