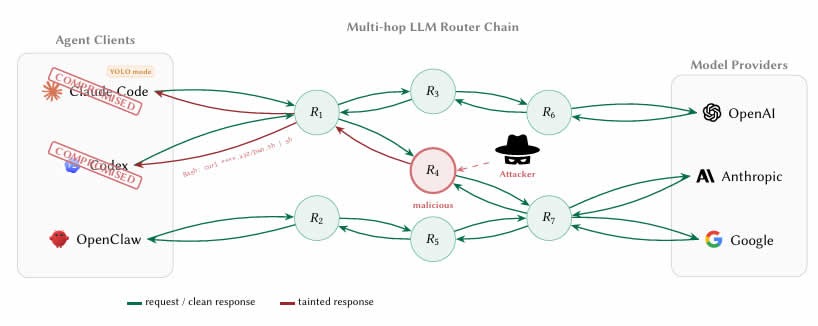

Исследователи из Калифорнийского университета обнаружили, что некоторые сторонние маршрутизаторы AI-модели большого языка (LLM) могут создавать уязвимости безопасности, которые могут привести к краже криптовалюты.

В документе, оценивающем атаки злонамеренных посредников на цепочку поставок LLM, опубликованном в четверг исследователями, выявлены четыре вектора атак, включая внедрение вредоносного кода и извлечение учетных данных.

«26 маршрутизаторов LLM тайно внедряют вредоносные вызовы инструментов и крадут кредиты», — сказал соавтор статьи Чаофан Шоу на X.

Агенты LLM все чаще направляют запросы через сторонних API-посредников или маршрутизаторы, которые объединяют доступ к таким поставщикам, как OpenAI, Anthropic и Google. Однако эти маршрутизаторы завершают соединения Internet TLS (Transport Layer Security) и имеют полный доступ к каждому сообщению в виде открытого текста.

Это означает, что разработчики, использующие агенты кодирования искусственного интеллекта, такие как Claude Code, для работы над смарт-контрактами или кошельками, могут передавать закрытые ключи, начальные фразы и конфиденциальные данные через инфраструктуру маршрутизатора, которая не была проверена или защищена.

ETH украден из криптовалютного кошелька-ловушки

Исследователи протестировали 28 платных роутеров и 400 бесплатных роутеров, собранных у публичных сообществ.

Их результаты были поразительными: девять маршрутизаторов активно внедряли вредоносный код, два использовали адаптивные триггеры уклонения, 17 получали доступ к учетным данным Amazon Web Services, принадлежащим исследователям, и один сливал эфир (ETH) из закрытого ключа, принадлежащего исследователям.

Исследователи предварительно профинансировали «ложные ключи» кошелька Ethereum номинальными остатками и сообщили, что потерянная в ходе эксперимента стоимость составила менее 50 долларов, но никаких дополнительных подробностей, таких как хеш транзакции, предоставлено не было.

Авторы также провели два «исследования отравления», показавшие, что даже безопасные маршрутизаторы становятся опасными, если они повторно используют утекшие учетные данные через слабые ретрансляторы.

Трудно сказать, являются ли маршрутизаторы вредоносными

Исследователи заявили, что обнаружить вредоносный маршрутизатор непросто.

«Граница между «обработкой учетных данных» и «кражей учетных данных» невидима для клиента, поскольку маршрутизаторы уже считывают секретные данные в виде открытого текста в рамках обычной пересылки».

Еще одной тревожной находкой стало то, что исследователи назвали «режимом YOLO». Это настройка во многих средах агентов ИИ, где агент автоматически выполняет команды, не запрашивая у пользователя подтверждения каждой из них.

Исследователи обнаружили, что ранее легальные маршрутизаторы могут быть незаметно превращены в оружие без ведома оператора, в то время как бесплатные маршрутизаторы могут красть учетные данные, предлагая в качестве приманки дешевый доступ к API.

«Маршрутизаторы LLM API находятся на критической границе доверия, которую экосистема в настоящее время рассматривает как прозрачный транспорт».

Исследователи рекомендовали разработчикам, использующим ИИ-агенты для написания кода, усилить защиту на стороне клиента, предложив никогда не позволять закрытым ключам или начальным фразам проходить через сеанс ИИ-агента.

Долгосрочное решение заключается в том, что компании, занимающиеся искусственным интеллектом, будут криптографически подписывать свои ответы, чтобы можно было математически проверить, что инструкции, которые выполняет агент, исходят из реальной модели.