Повідомляється, що генеральний директор Anthropic Даріо Амодей відновив переговори з Міністерством оборони США в останню хвилину, намагаючись забезпечити безперервний доступ до контрактів Пентагону, оскільки компанія стикається з можливістю того, що адміністрація Трампа поставить ярлик ризику для ланцюга поставок.

Amodei проводив дискусії з Емілем Майклом, заступником міністра оборони США з досліджень та інженерії, щоб завершити умови, що регулюють використання військовими моделей штучного інтелекту Anthropic, повідомляє Financial Times з посиланням на людей, знайомих із цим питанням.

Відповідно до звіту, нова угода дозволить Пентагону продовжувати використовувати технологію компанії та може запобігти офіційному призначенню, яке змусило б підрядників у ланцюжку постачання оборонних поставок розірвати зв’язки з розробником ШІ.

Переговори відбулися після різкого зриву переговорів минулого тижня. Повідомляється, що Майкл звинуватив Amodei у «брехуні» з «божественним комплексом», тоді як дискусії припинилися після того, як обидві сторони не змогли дійти згоди щодо формулювань, які Anthropic вважає необхідними для запобігання неправильному використанню своїх технологій.

Переговори в Пентагоні зайшли в глухий кут через положення про аналіз масових даних

У внутрішній записці для співробітників, з якою ознайомилося FT, Амодей, як повідомляється, написав, що ближче до кінця переговорів Пентагон запропонував прийняти ширші умови Anthropic, якщо компанія вилучить пункт, що обмежує «аналіз масових отриманих даних». Він сказав, що ця фраза мала на меті захистити від можливого масового домашнього стеження, сценарій, який Anthropic розглядає як червону лінію, поряд із використанням ШІ в летальній автономній зброї.

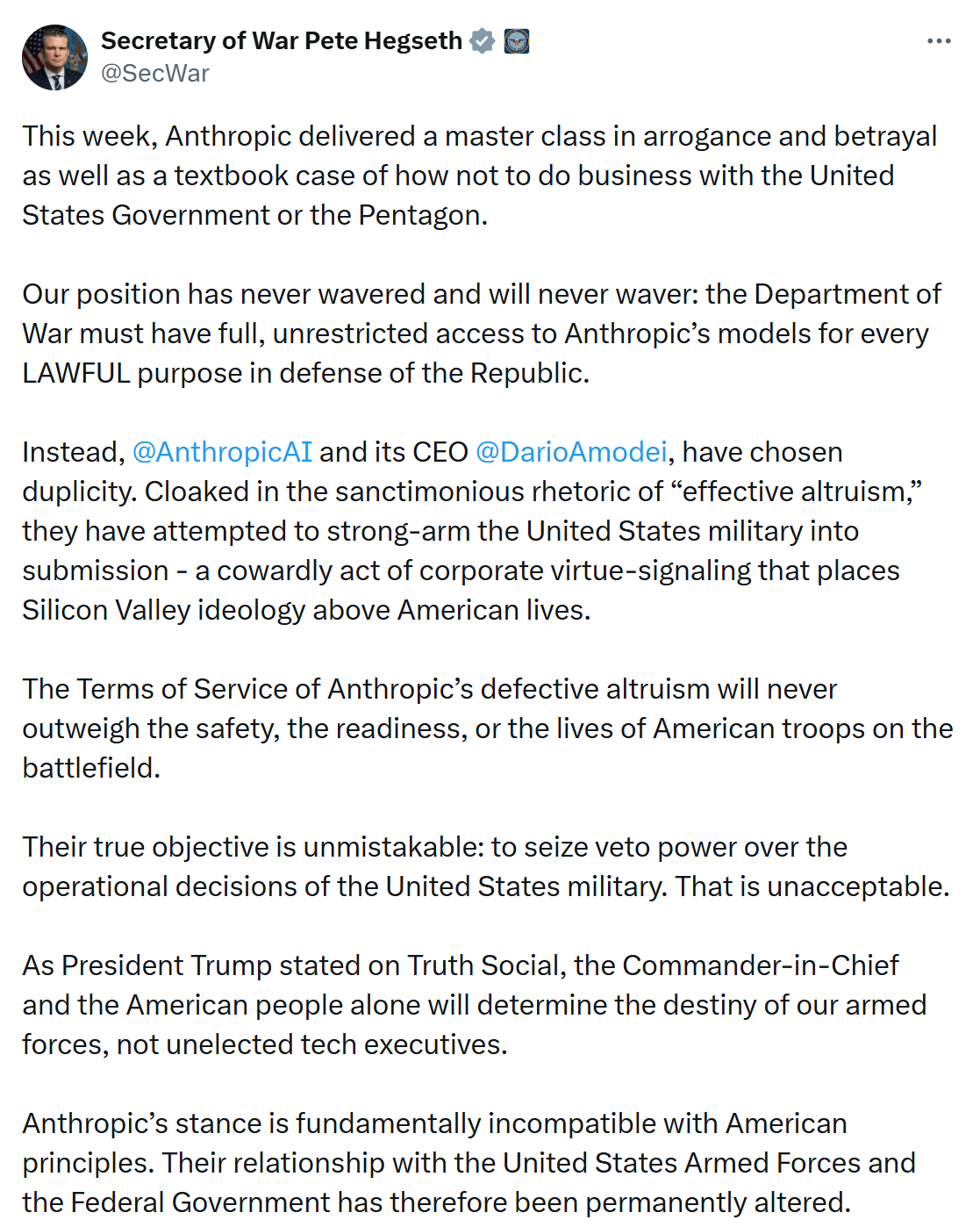

Суперечка загострилася після того, як міністр оборони Піт Хегсет попередив, що Anthropic може бути визнано ризиком для ланцюжка поставок, що фактично заморозить компанію в мережах військових закупівель США.

Протистояння виникає, незважаючи на існуючі зв’язки Anthropic з оборонним сектором. У липні 2025 року Міністерство оборони США уклало контракт на суму до 200 мільйонів доларів і стала першим постачальником штучного інтелекту, чиї моделі використовувалися в секретних середовищах і органами національної безпеки.

Як повідомляв Cointelegraph, американські військові навіть використовували модель Claude AI від Anthropic для підтримки великого авіаудару по Ірану через кілька годин після того, як президент Дональд Трамп наказав федеральним агентствам припинити використання систем компанії.

Технічні групи попереджають, що позначка ризику може зашкодити керівництву штучного інтелекту США

Тим часом у середу в листі до Трампа технічні групи попередили, що маркування вітчизняної фірми штучного інтелекту як ризик для ланцюга поставок може підірвати лідерство США в галузі штучного інтелекту. Групи стверджували, що ставлення до американської технологічної компанії «як до іноземного противника, а не як до активу» може перешкодити інноваціям і послабити здатність Америки конкурувати з Китаєм у глобальній гонці ШІ.

Підписантами були Асоціація індустрії програмного забезпечення та інформації, TechNet, Асоціація індустрії комп’ютерів та комунікацій та Альянс програмного забезпечення для бізнесу. Ці організації представляють сотні американських технологічних компаній, включаючи виробників чіпів зі штучним інтелектом Nvidia, Alphabet Google і Apple.