Фірма штучного інтелекту OpenAI показала, що виявила та зірвала кілька онлайн-кампаній, які використовували її технологію для маніпулювання громадською думкою по всьому світу.

30 травня Сем Альтман, засновник компанії зі штучного інтелекту OpenAI, заявив, що «закрив облікові записи, пов’язані з таємними операціями впливу».

«За останні три місяці ми зірвали п’ять прихованих IO [операцій впливу], які мали на меті використовувати наші моделі для підтримки оманливої діяльності в Інтернеті».

Зловмисники використовували штучний інтелект, щоб створювати коментарі до статей, створювати імена та біографії для облікових записів у соціальних мережах, а також перекладати та вичитувати тексти.

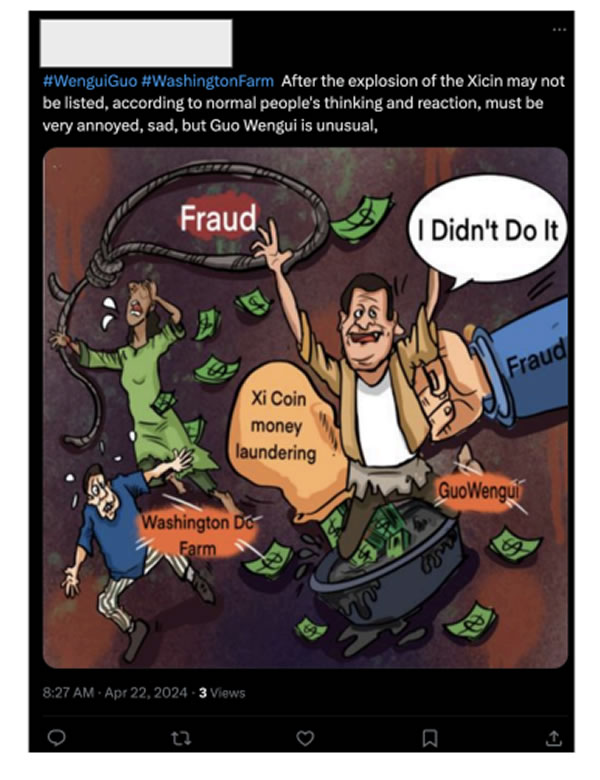

Фірма, яка стоїть за ChatGPT, заявила, що операція під назвою «Spamouflage» використовувала OpenAI для дослідження соціальних медіа та створення багатомовного контенту на таких платформах, як X, Medium і Blogspot, у спробі «маніпулювати громадською думкою або впливати на політичні результати».

Він також використовував ШІ для налагодження коду та керування базами даних і веб-сайтами.

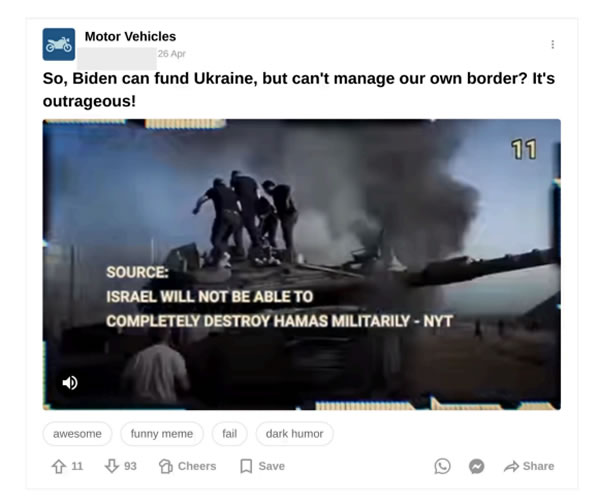

Крім того, операція під назвою «Bad Grammar» була спрямована на Україну, Молдову, країни Балтії та Сполучені Штати з використанням моделей OpenAI для запуску ботів Telegram і створення політичних коментарів.

Інша група під назвою Doppelganger використовувала моделі штучного інтелекту для створення коментарів англійською, французькою, німецькою, італійською та польською мовами, які були опубліковані на X і 9GAG, також призначені для маніпулювання громадською думкою, додали в ньому.

OpenAI також згадав групу під назвою «Міжнародний союз віртуальних медіа», яка використовувала цю технологію для створення довгих статей, заголовків і вмісту веб-сайтів, опублікованих на їх пов’язаному веб-сайті.

OpenAI заявив, що також порушив роботу комерційної компанії під назвою STOIC, яка використовувала штучний інтелект для створення статей і коментарів на платформах соціальних мереж, таких як Instagram, Facebook, X, і на веб-сайтах, пов’язаних з операцією.

OpenAI пояснив, що вміст, опублікований цими різними операціями, зосереджений на широкому спектрі проблем:

«Включно з вторгненням Росії в Україну, конфліктом у Газі, виборами в Індії, політикою в Європі та Сполучених Штатах, а також критикою китайського уряду з боку китайських дисидентів та іноземних урядів».

За темою: OpenAI Сема Альтмана, як повідомляється, веде переговори про партнерство з його іншою фірмою, Worldcoin

«Наші тематичні дослідження наводять приклади деяких із найбільш популярних і найтриваліших кампаній впливу, які зараз активні», — сказав The New York Times Бен Німмо, головний дослідник OpenAI, який написав звіт.

Видання також повідомило, що це був перший випадок, коли велика фірма ШІ розкрила, як її спеціальні інструменти використовувалися для онлайн-обману.

«Поки що ці операції, схоже, не виграли від значного збільшення залучення аудиторії або охоплення в результаті наших послуг», — резюмував OpenAI.