Рост технологии ИИ также вызвал всплеск мошенничества с поддержкой AI. Только в первом квартале 2025 года было демонтировано 87 мошеннических колец, управляемых глубокими темпами. Эта тревожная статистика, выявленная в исследовательском отчете по борьбе с проведением месяца на 2025 год, в соавторстве с Bitget, Slowmist и Elliptic, подчеркивает растущую опасность мошенничества, управляемых AI, в пространстве криптовалюты.

В отчете также показано 24-процентное увеличение потери мошенничества с криптовалютой на 24%, достигнув в общей сложности 4,6 млрд. Долл. США в 2024 году. Почти 40% случаев мошенничества с высокой стоимостью включали в себя технологии Deepfake, причем мошенники все чаще используют сложные оличиния общественных показателей, основателей и руководителей платформы для Deceive пользователей.

Связанный: как ИИ и Deepfakes питают новые мошенничество с криптовалютой

Грейси, генеральный директор Bitget, сказал Cointelegraph: «Скорость, с которой мошенники теперь могут генерировать синтетические видео в сочетании с вирусной природой социальных сетей, дает DeepFakes уникальное преимущество как в охвате, так и в правдоподобия».

Защита от мошенничества с AI выходит за рамки технологий-для мышления требуется фундаментальное изменение мышления. В эпоху, когда синтетические средства массовой информации, такие как Deepfakes, могут убедительно подражать реальным людям и событиям. Доверие должно быть тщательно заработано за счет прозрачности, постоянной бдительности и строгой проверки на каждом этапе.

DeepFakes: коварная угроза в современных мошенничествах на криптовалюте

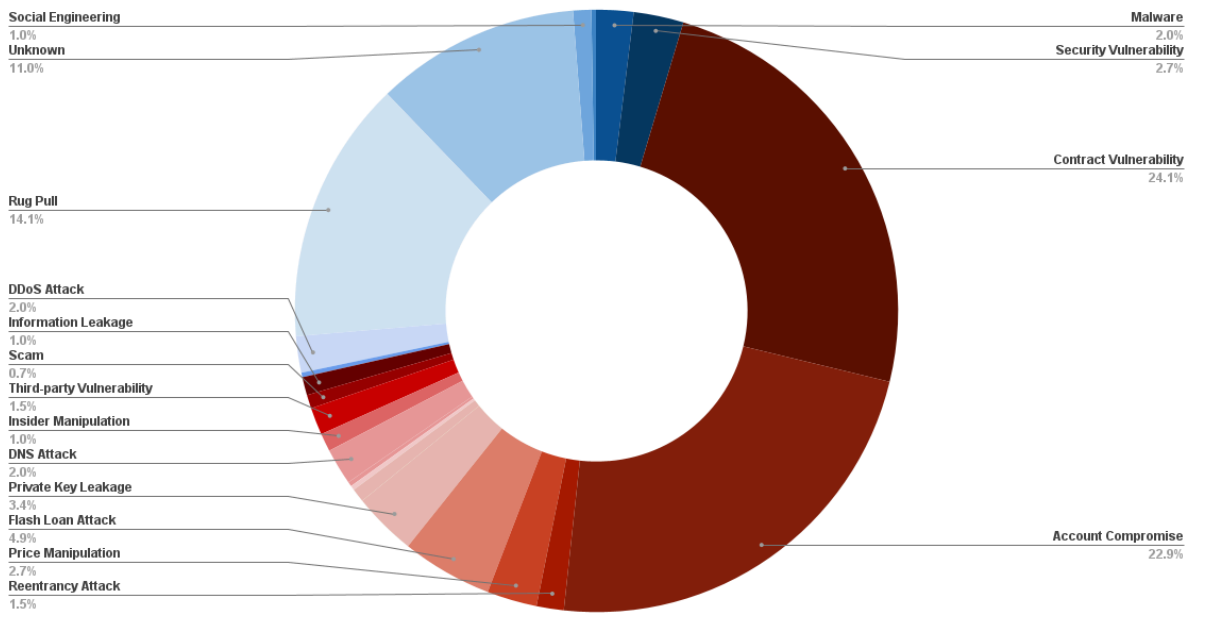

В отчете подробно описывается анатомия современной мошенничества с криптовалютой, указывающие на три доминирующие категории: сгенерированные AI подражание глубокогофакция, схемы социальной инженерии и мошенничество в стиле Ponzi, замаскированные под проекты Defi или GameFI. Глубобы особенно коварны.

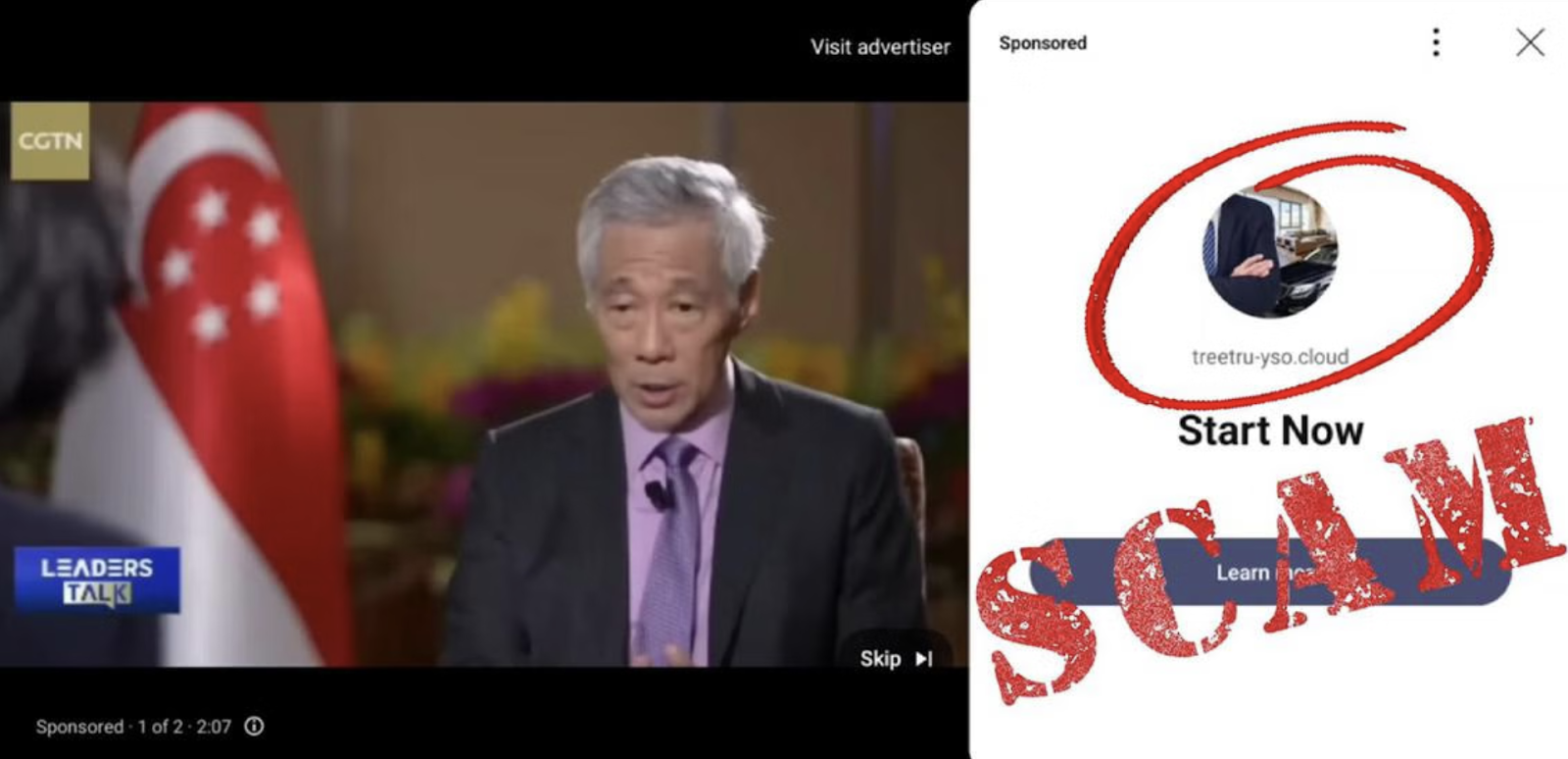

ИИ может имитировать текст, голосовые сообщения, выражения лица и даже действия. Например, поддельные видео одобрения инвестиционных платформ от общественных деятелей, таких как премьер -министр Сингапура и Элон Маск, – это тактика, используемая для эксплуатации общественного доверия через Telegram, X и другие социальные сети.

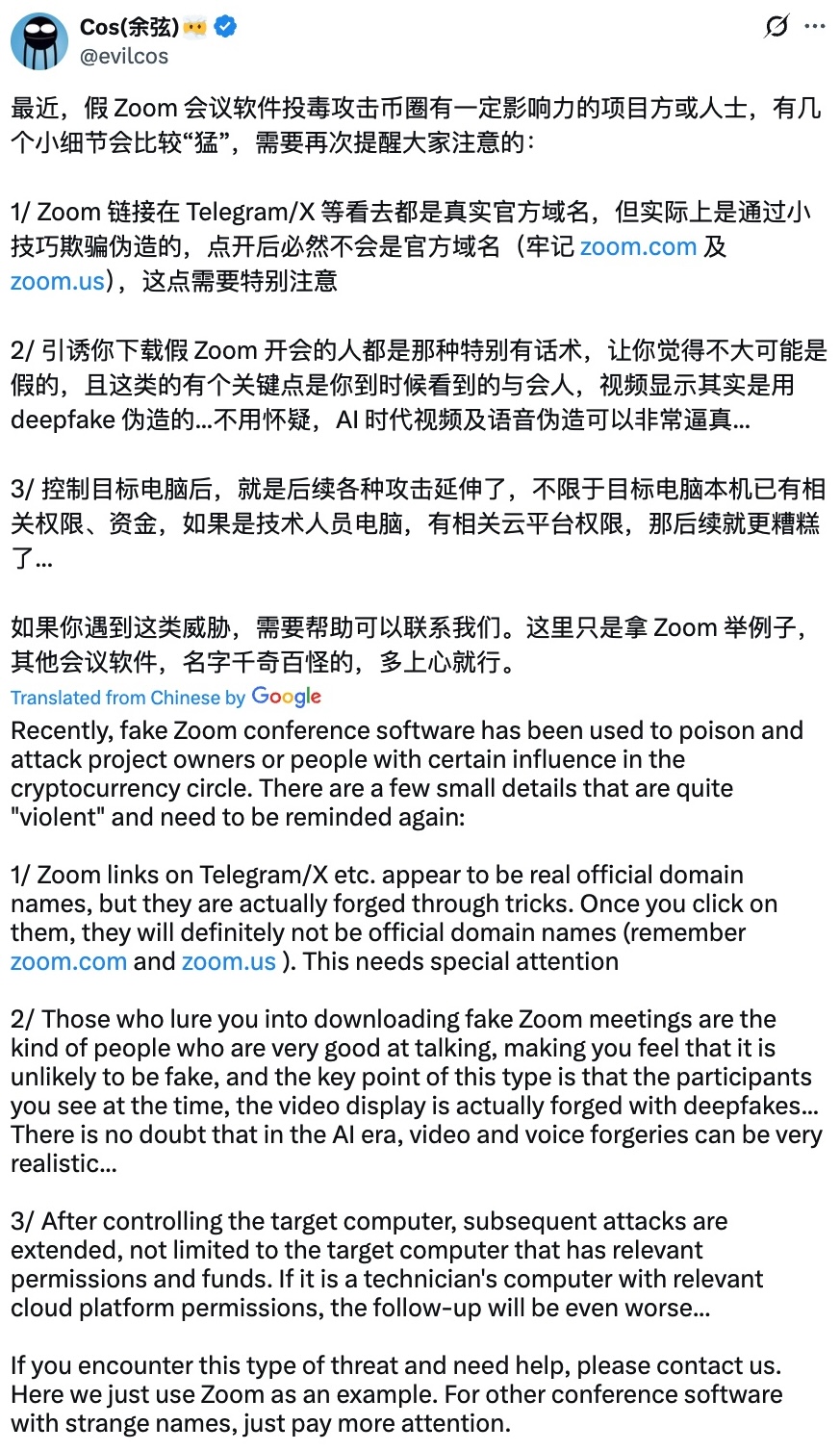

ИИ может даже имитировать реакции в реальном времени, что делает эти мошенничество все труднее отличить от реальности. Сандип Нарвал, соучредитель полигона платформы блокчейна, поднял тревогу в посте 13 мая на X, показывая, что плохие актеры выдавали себя за него через Zoom. Он упомянул, что несколько человек связались с ним по телеграмме, спрашивая, был ли он на зум -звонке с ними и просил ли он их установить сценарий.

Связанные: мошенники AI в настоящее время выдают себя за большие правительство США, говорит ФБР

Генеральный директор Slowmist также выпустил предупреждение о Deepfakes Zoom, призывая людей обратить пристальное внимание на доменные имена зумных ссылок, чтобы избежать падения жертвы таких мошенничества.

Новые угрозы мошенничества требуют более умной защиты

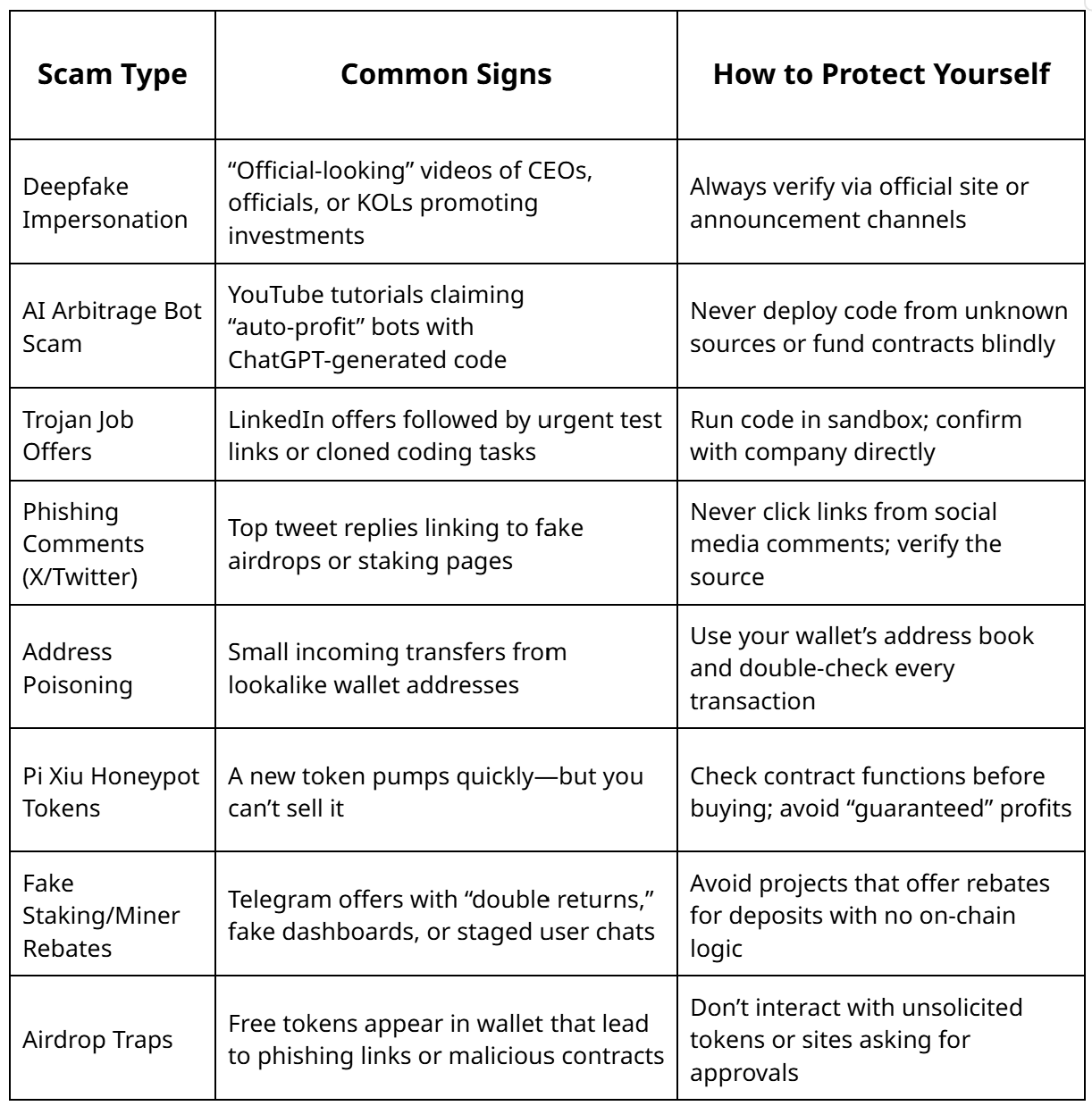

По мере того, как мошенничество с AI становятся все более продвинутыми, пользователям и платформам нужны новые стратегии, чтобы оставаться в безопасности. Видео с глубоким фаршированием, фальшивые тестирование работы и фишинговые ссылки затрудняют мошенничество.

Для учреждений регулярно обучение безопасности и сильная техническая защита необходимы. Предприятиям рекомендуется запускать фишинговые моделирование, защищать системы электронной почты и контролировать код утечек. Создание культуры, первой безопасности-где сотрудники проверяют, прежде чем они доверяют-это лучший способ остановить мошенничество, прежде чем они начнут.

Gracy предлагает обычным пользователям простой подход: «Проверьте, изолируйте и замедлите». Она также сказала:

«Всегда проверяйте информацию на официальных веб -сайтах или надежных учетных записях социальных сетей – никогда не полагаются на ссылки, разделенные в чатах Telegram или в комментариях в Твиттере».

Она также подчеркнула важность изоляции рискованных действий, используя отдельные кошельки при изучении новых платформ.