OpenAI каже, що ігнорував занепокоєння своїх експертних тестерів, коли він розгорнув оновлення до своєї флагманської моделі штучного інтелекту Chatgpt, яка зробила її надмірно приємною.

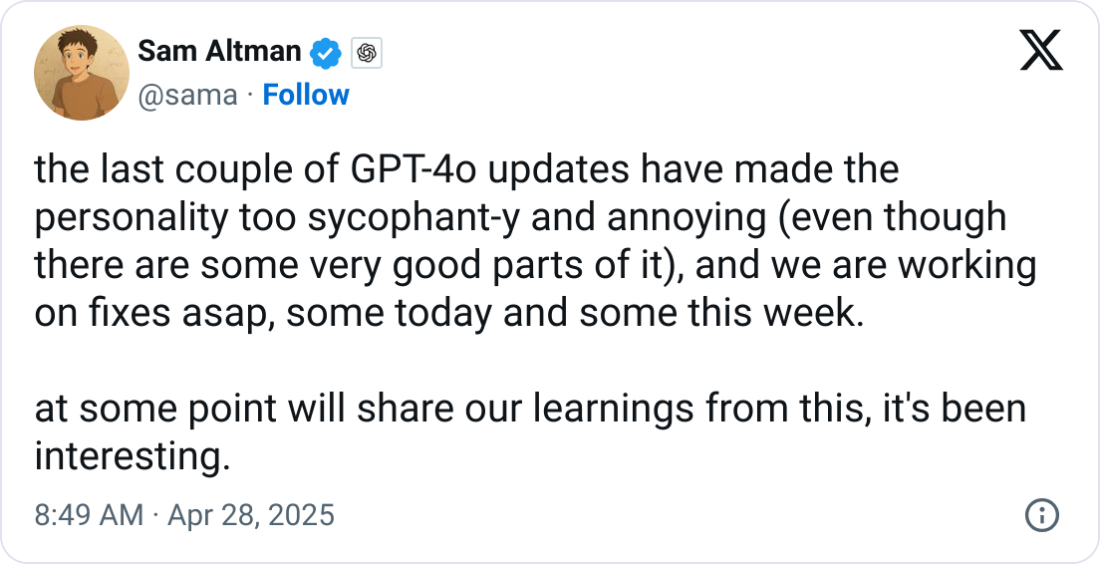

Компанія оприлюднила оновлення до своєї моделі GPT -4O 25 квітня, яка зробила її “помітно більш сикофантичним”, яке потім відкотилося через три дні через проблеми безпеки, заявив OpenAI у публікації в блозі після посмертного дня 2 травня.

Виробник Chatgpt заявив, що його нові моделі проходять перевірку безпеки та поведінки, а “внутрішні експерти витрачають значний час, взаємодіючи з кожною новою моделлю перед запуском”, що означало, щоб виловити проблеми, пропущені іншими тестами.

Під час огляду останньої моделі перед тим, як він став публічним, OpenAi сказав, що “деякі експертні тестери вказали, що поведінка моделі” відчуває себе “трохи вимкнено”, але вирішила запустити “через позитивні сигнали користувачів, які випробували модель”.

“На жаль, це був неправильний дзвінок”, – зізналася компанія.”Якісні оцінки натякали на щось важливе, і ми повинні були приділяти пильну увагу. Вони набирали на сліпому місці в інших наших EVALS та показниках”.

Загалом, текстові моделі AI навчаються, отримуючи винагороду за те, що вони дають відповіді, які є точними або оціненими їх тренерами. Деякі нагороди отримують більш важке зважування, що впливає на те, як реагує на модель.

OpenAi заявив, що введення сигналу винагороди за зворотним зв’язком користувача послабило “Первинний сигнал винагород моделі, який тримає сикофанцію”, який підказав її до більш зобов’язання.

“Зокрема, зворотній зв’язок користувача може сприяти більш приємним відповідям, ймовірно, посилюючи зміну, яку ми побачили”, – додав він.

Зараз OpenAI перевіряє наявність відповідей

Після того, як оновлена модель AI розгорнулася, користувачі Chatgpt поскаржилися в Інтернеті на свою тенденцію до душі похвали будь -якої ідеї, яку вона була представлена, як би погано, що призвело до того, що OpenAI поступився у публікації в блозі 29 квітня, що він “був надто лестощим або приємним”.

Наприклад, один користувач сказав Chatgpt, що хоче розпочати бізнес, який продає лід через Інтернет, який передбачав продаж звичайної старої води для клієнтів для реконструкції.

В останньому післясмертному повідомленні він сказав, що така поведінка з його ШІ може створити ризик, особливо щодо таких питань, як психічне здоров’я.

“Люди почали використовувати Chatgpt для глибокої особистої поради – те, чого ми не бачили стільки ж року тому”, – сказав Оплай.”Оскільки AI та суспільство спільно розвивалися, стало зрозуміло, що нам потрібно ставитись до цього випадку з великою ретельністю”.

Пов’язано: Користувачі криптовалют охолоджуються з AI, що займаються своїми портфелями: опитування

Компанія заявила, що обговорювала ризики з сикофанцією “вже деякий час”, але вона не була чітко позначена для внутрішнього тестування, і вона не мала конкретних способів відстеження сикофанції.

Тепер він буде додати “оцінки сикофенції”, коригуючи процес його перегляду безпеки, щоб “офіційно розглянути питання про поведінку” та заблокувати запуск моделі, якщо вона представляє проблеми.

OpenAi також зізнався, що не оголосило про останню модель, оскільки вона очікувала, що вона “буде досить тонким оновленням”, яке вона пообіцяла змінити.

“Немає такого поняття, як” маленький “запуск”, – написала компанія.”Ми спробуємо повідомити навіть про тонкі зміни, які можуть змістовно змінити те, як люди взаємодіють з Чатгптом”.

AI Eye: криптовалюта AI токени Surge 34%, чому Чатгпт такий поцілунок